En blogg om data, kunstig intelligens og prosjektene mine

Contents

- 1 En blogg om data, kunstig intelligens og prosjektene mine

- 1.1 Automatisk tekstoppsummering

- 1.2 �� Modelltrening

- 1.3 En blogg om data, kunstig intelligens og prosjektene mine.

- 1.4 De forskjellige typene sammendrag

- 1.5 AI og nevrale nettverk revolusjonerer det automatiske sammendraget

- 1.6 Et eksempel på et hybridverktøy: Potara

- 1.7 Hva er en god automatisk sammendrag ?

Den automatiske sammendraget er å ta en lang tekst, eller til og med et sett med tekster, og automatisk generere en mye kortere tekst som inneholder flertallet av informasjonen. Enkel ? Ikke så mye. For det første må du være enig i hvilken informasjon som virkelig er viktig. Deretter må vi kunne trekke dem ut ordentlig, omorganisere dem, alt i en grammatisk tekst og uten menneskelig inngripen. Og det er uten å regne med det store antallet varianter av mulige sammendrag !

Automatisk tekstoppsummering

Med eksplosjonen av teksturinnsamling og lagring er behovet for å analysere og trekke ut relevant informasjon fra denne massen mer og mer til stede.

I tillegg tilrettelagte bommen i dype læringsmodeller for automatisk naturlig språkbehandling (TALN) bruk av tekstdata i driftsspørsmål. Den automatiske tekstoppsummeringen, på samme måte som svarspørsmålet, likhetsanalysen, klassifiseringen av dokument og andre oppgaver knyttet til TALN er en del av disse problemene.

Det er i denne sammenhengen at Laboratorieinnovasjon De Lincoln har bestemt seg for å utføre arbeid med det automatiske tekstsammendraget. Disse verkene har gjort det mulig å etablere et mål for de automatiske sammendragsmodellene som er tilgjengelige for språket fransk, å forårsake vår egen modell og til slutt sette den i produksjon.

�� Modelltrening

Data

Før vi kunne starte arbeidet vårt, måtte vi først bygge en database for å lære automatiske sammendragsmodeller. Vi har gjenfunnet presseartikler fra flere franske nyhetssider. Denne basen inneholder ~ 60K -artikler og oppdateres kontinuerlig.

State of the Art

Automatiske sammendragsalgoritmer kan skilles inn i to kategorier: Sammendrag Ekstrakt og sammendrag abstractivt. I rammen Ekstrakt, Sammendragene er bygget fra setninger hentet fra teksten mens sammendragene abstractivt genereres fra nye setninger.

Automatiske sammendragsmodeller er ganske vanlige på engelsk, men de er mye mindre på fransk.

Beregninger

For evaluering av modeller brukte vi følgende beregninger:

RØD : Utvilsomt målingen som oftest er rapportert i sammendragsoppgaver, beregner tilbakekallingsorientert understudi for gisting-evaluering (Lin, 2004) antall lignende N-gram mellom det evaluerte sammendraget og det menneskelige referansesammendraget.

Meteor: Beretningen for evaluering av oversettelse med eksplisitt bestilling (Banerjee og Lavie, 2005) ble designet for evaluering av automatiske oversettelsesresultater. Det er basert på det harmoniske gjennomsnittet av presisjon og tilbakekalling på unigrams, og tilbakekallingen har en vekting større enn presisjon. Meteor brukes ofte i automatiske sammendragspublikasjoner (se et al., 2017; Dong et al., 2019), i tillegg til rødt.

Nyhet: Det har blitt lagt merke til at noen abstrakte modeller hviler for mye på ekstraksjon (se et al., 2017; Krysci ‘Nski et al.‘, 2018). Derfor har det blitt vanlig å måle prosentandelen av nye N-gram produsert innenfor sammendragene som genereres.

Kilde: Oversettelse fra MLSum Paper [2].

Distribusjon av modeller

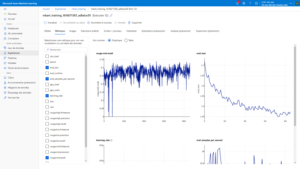

For modellopplæring brukte vi Cloud Azure ML -tjenesten som gir et komplett miljø for trening, overvåking og distribusjon av modeller.

Vi har mer presist brukt Python SDK som lar deg administrere hele Azureml -miljøet på en programmatisk måte, fra lanseringen av “Jobs” til distribusjonen av modeller.

Imidlertid innkapslet vi vår endelige modell i en containerisert kolbeapplikasjon og deretter distribuert via CI/CD -rørledninger på en Kubernetes -klynge

Resultatene

Først av alt gjorde vi flere forsøk, og ledet modellene på 10K -artikler, og varierer antall symboler gitt ved starten av modellen (512 eller 1024) og forskjellige arkitekturer.

Første observasjon: Røde og meteorberegninger virker ikke veldig egnet for ytelsesvurderingen av modellene våre. Vi valgte derfor å basere sammenligningene våre bare på nyhetspoengene og valgte arkitektur favoriserer mer abstrakte sammendrag.

Etter å ha presset opplæringen av modellen vår på 700 000 varer, forbedret vi resultatene betydelig og validerte en første versjon som du finner nedenfor.

Oppmerksomhetspunkter

Utover ytelsen tillot dette eksperimentet oss å fremheve noen grenser Automatisk sammendrag:

Foreløpig størrelsen på teksten i inngangene til typemodellene Forvandle er begrenset av kapasiteten til minne om GPUer. Kostnaden i minnet er kvadratisk med størrelsen på teksten som input, dette utgjør et reelt problem for oppgavene med automatisk sammendrag der teksten som skal oppsummeres er ofte lang nok.

Det er veldig vanskelig å finne relevante beregninger for å vurdere tekstgenereringsoppgaver.

Vær forsiktig vekten av avtrekkeren : Vi har også opplevd flere problemer relatert til data i seg selv. Hovedproblemet er at artikkelen i artikkelen ofte var en parafrase eller til og med en duplikat av de første setningene i artikkelen. Dette hadde konsekvensen av å oppmuntre modellene våre til å være mer utvinnende enn abstrakt ved å bare returnere de første setningene i artikkelen. Det var derfor nødvendig å gjøre et kurasjonsarbeid ved å slette artiklene som poserer problemet for å unngå denne typen skjevheter.

En blogg om data, kunstig intelligens og prosjektene mine.

Den automatiske sammendraget er å ta en lang tekst, eller til og med et sett med tekster, og automatisk generere en mye kortere tekst som inneholder flertallet av informasjonen. Enkel ? Ikke så mye. For det første må du være enig i hvilken informasjon som virkelig er viktig. Deretter må vi kunne trekke dem ut ordentlig, omorganisere dem, alt i en grammatisk tekst og uten menneskelig inngripen. Og det er uten å regne med det store antallet varianter av mulige sammendrag !

Jeg var i stand til å jobbe i omtrent et år med dette spennende temaet rett før doktorgraden min, dette innlegget er derfor en mulighet for meg å fordype meg i dette emnet og å gjøre rede for de nyeste innovasjonene i domenet.

Så la oss ta en oversikt over dette temaet, ved å lage ved å beskrive de forskjellige typene sammendrag som finnes, før vi dveler ved to typer systemer litt i detalj: de fra AI og nevrale nettverk, og de som er ganske fokusert på optimal utvinning av informasjon.

De forskjellige typene sammendrag

Når vi snakker om sammendrag, tenker vi ofte på bakomslaget til en bok eller beskrivelsen av manuset for en film. Generelt unngår de å ødelegge slutten, når dette er nettopp det man vil be om et verktøy med klassisk automatisk sammendrag: å fortelle intriger, slik at sammendraget kan være nok til å kjenne det vesentlige. Her handler det om Mono-dokumentsammendrag, Det vil si at vi bare oppsummerer et enkelt dokument (en film, en bok, en artikkel, …).

Tvert imot, vi kan ønske oss Multi-dokumentarisk sammendrag, At vi møtes oftere i sammenheng med presseanmeldelser: vi ønsker å ha et sammendrag av den viktigste informasjonen som rapportert av forskjellige presseorganisasjoner.

Når vi har bestemt oss for hvilken type data vi søker å oppsummere, mono eller multi-dokumentarer, har vi valget mellom to tilnærminger: denEkstrakt, som består i å trekke ut som hva med informasjonen før du legger den tilbake for å lage et sammendrag, og tilnærmingen generativ, som består i å lage nye setninger, som ikke opprinnelig vises i dokumentene, for å ha et mer flytende og friere sammendrag.

I tillegg til disse kriteriene, er det forskjellige oppsummeringsstiler, som vi ikke vil nærme oss her: Oppdater sammendrag som består i å oppsummere informasjonen som vises i et nytt dokument og som ikke ble oppført så langt, oppsummert rettet som består i å ta i bruk en presis vinkel gitt av brukeren, ..

AI og nevrale nettverk revolusjonerer det automatiske sammendraget

Fram til midten av 2010 -tallet ble de fleste av sammendragene utvinnet. Imidlertid eksisterte stort mangfold allerede i disse algoritmene som kan variere fra utvalg og utvinning av hele setninger til utvinning av presis informasjon som ble tilbakelagt, deretter i tekster med hull tilberedt på forhånd kalt maler. Ankomsten av nye tilnærminger basert på nevrale nettverk har endret situasjonen betydelig. Disse algoritmene er mye mer effektive enn de tidligere for å generere grammatisk og væsketekst, som hva som kan gjøres med denne GPT -demoen.

Nevrale nettverk krever imidlertid store mengder data for å bli opplært og er relativt uklare. De jobber perfekt for å generere kommentarer som sannhet er av liten betydning, men kan sterkt generere motstridende eller ganske enkelt feil informasjon som er problematisk i sammenheng med presseartikler sammendrag for eksempel for eksempel. Mange forskningsartikler er interessert i disse “hallusinasjonene” av nevrale nettverk.

Et eksempel på et hybridverktøy: Potara

Det automatiske sammendraget var det første forskningsfaget jeg var interessert i, og jeg hadde muligheten til å utvikle under min mester et hybridsystem med sammendrag av utvinning/generasjon for en multi-document-tilnærming, det vil si oppsummering av et sett med dokumenter som snakker av samme emne.

Tanken var å starte fra en klassisk utvinning, nemlig å identifisere de viktigste setningene og sette dem sammen for å generere et sammendrag. Problemet med denne tilnærmingen er at de viktigste setningene ofte kan forbedres ytterligere. For eksempel, i en artikkel som snakker om en presidentforskyvning, møtte uttrykket “Emmanuel Macron sin amerikanske motpart og diskutert økonomi” forbedres i “Emmanuel Macron møtte Joe Biden og diskutert økonomi”. Journalister unngår nøye med øving, vi befinner oss ofte konfrontert med denne typen fenomen.

For å overvinne denne mangelen, kan vi identifisere lignende setninger som er til stede i forskjellige dokumenter og prøve å slå dem sammen for å få en bedre setning. ANSI, fra følgende to setninger:

- Emmanuel Macron møtte sin amerikanske kollega i Washington og snakket om økonomi på lang tid.

- Den franske presidenten møtte Joe Biden og diskuterte økonomi.

Vi kan lage en kort og informativ setning:

- Emmanuel Macron møtte Joe Biden i Washington og diskuterte økonomi.

Flere trinn er nødvendige for å oppnå dette resultatet: å finne lignende setninger, finne den beste fusjonen, sjekke at fusjon er mye bedre enn en original setning. De tar del av mange teknologier: Word2 med nevrale nettverk for å finne lignende setninger, co-cccurence grafer for å slå dem sammen, ILP-optimalisering for å velge de beste fusjonene.

Hvis du vil se mer, er Potara åpen kildekode, men har ikke blitt opprettholdt på en stund. Dette prosjektet hadde særlig fungert som et utstillingsvindu da jeg ble utgitt og hadde derfor dokumentasjon, tester, kontinuerlig integrasjon, distribusjon på PYPI, ..

Hva er en god automatisk sammendrag ?

Hvis visse kriterier virker åpenbare og relativt enkle å vurdere (for eksempel grammatikalitet), er andre mye mer sammensatte. Å bestemme hva den viktigste informasjonen om en tekst allerede er en veldig subjektiv oppgave i seg selv. Evaluer flytningen, det riktige valget av ordene som brukes, kommer tilbake til publiseringsarbeidet, og la oss ikke snakke om den politiske orienteringen som et sammendrag kan ta !

De nye generative modellene basert på nevrale nettverk vil sannsynligvis introdusere pejorative dommer eller kvalifiseringskamp (eller brukervennlige), en effekt søkt når det gjelder å generere en filmkritiker, men mye mindre når du snakker om program for en presidentkandidat !

Automatisk sammendrag er derfor fortsatt et veldig aktivt emne i forskning, og kan være et øyeblikk, spesielt med tanke på evnen til å veilede resultatet av algoritmen, nettopp mot en bestemt følelse, en spesifikk stil, en politisk fargelegging gitt. I bransjen begynner han bare å komme inn i veldig spesifikke ledere (sammendrag av møter for eksempel).

Presidential 2022: Til dine data !

3 eksempler på dataprosjekter som skal utføres for presidentvalget i 2022.